متا از مجموعه دادههای HOT۳D برای آموزش پیشرفته بینایی کامپیوتری رونمایی کرد

به گزارش گروه دانشگاه خبرگزاری دانشجو، در حالی که بیشتر انسانها به طور ذاتی میتوانند از دستهای خود برای برقراری ارتباط با دیگران یا گرفتن و دستکاری اشیا استفاده کنند، بسیاری از سیستمهای رباتیک موجود فقط در انجام کارهای ساده دستی برتری دارند. در سالهای اخیر، دانشمندان کامپیوتر در سرتاسر جهان در حال توسعه مدلهای مبتنی بر یادگیری ماشینی بودهاند که میتوانند تصاویر انسانها را در حال انجام کارهای دستی پردازش کنند و از اطلاعات بهدستآمده برای بهبود دستکاری ربات استفاده کنند، که به نوبه خود میتواند تعامل یک ربات را هم با انسان و هم با اشیاء اطرافش افزایش دهد.

همچنین میتوان از مدلهای مشابه برای ایجاد رابطهای انسان و ماشین استفاده کرد که بر بینایی رایانه تکیه میکنند یا قابلیتهای سیستمهای واقعیت افزوده و مجازی (AR و VR) را گسترش میدهند. برای آموزش این مدلهای یادگیری ماشین، محققان نیاز به دسترسی به مجموعه دادههای با کیفیت بالا دارند که شامل فیلمهای مشروح شده از انسانها در انجام کارهای دستی مختلف در دنیای واقعی است.

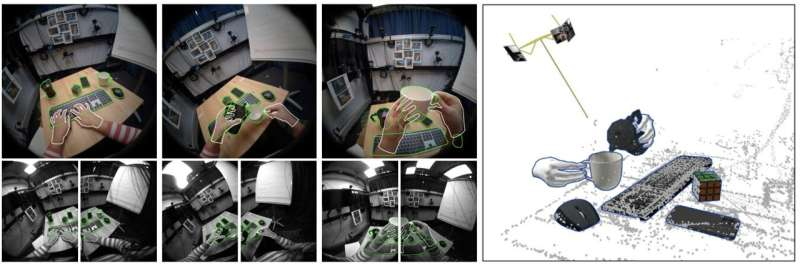

محققان در Meta Reality Labs اخیرا HOT۳D را معرفی کردند، مجموعه داده جدیدی که میتواند به سرعت بخشیدن به تحقیقات یادگیری ماشین برای تجزیه و تحلیل تعاملات دست و شی کمک کند. این مجموعه داده، که در مقاله منتشر شده در سرور preprint arXiv ارائه شده است، حاوی ویدیوهای سه بعدی من محور با کیفیت بالا از کاربران انسانی است که اشیاء مختلف را میگیرند و دستکاری میکنند، که از دیدگاه خود محوری گرفته شده است (یعنی آینه کاری که فردی که کار را انجام میدهد منعکس میکند. ببینید).

بنجری، شکودرانی و همکارانشان در مقاله خود نوشتند: ما HOT۳D را یک مجموعه داده در دسترس عموم برای ردیابی دست و اشیاء خودمحور به صورت سه بعدی معرفی میکنیم.

این مجموعه داده بیش از ۸۳۳ دقیقه (بیش از ۳.۷ میلیون تصویر) جریان تصویر RGB/تک رنگ با چند نمای را ارائه میدهد که ۱۹ سوژه را در حال تعامل با ۳۳ شی صلب مختلف، سیگنالهای چند وجهی مانند نگاه چشم یا ابرهای نقطه صحنه و حاشیه نویسیهای حقیقت زمین شامل حالتهای سه بعدی اشیا، دستها و دوربین ها، و مدلهای سه بعدی دستها و اشیا جامع است. "

مجموعه داده جدید گردآوری شده توسط این تیم در Meta Reality Labs شامل نمایشهای سادهای از انسانها در برداشتن و مشاهده اشیاء و همچنین قرار دادن آنها بر روی سطح است. با این حال، همچنین شامل نمایشهای دقیق تری است که نشان میدهد کاربران اعمالی را که معمولاً در محیطهای اداری و خانگی مشاهده میشود، مانند برداشتن و استفاده از ظروف آشپزخانه، دستکاری غذاهای مختلف، تایپ کردن روی صفحه کلید و ... انجام میدهند.

فیلم مشروح موجود در مجموعه داده با استفاده از دو دستگاه توسعه یافته در متا، یعنی عینک Project Aria و هدست Quest ۳ جمع آوری شده است. پروژه آریا منجر به ایجاد نمونه اولیه عینک حسگر سبک وزن برای کاربردهای واقعیت افزوده (AR) شد.

عینک Project Aria میتواند دادههای صوتی و تصویری را ضبط کند و در عین حال حرکات چشم کاربرانی را که از آن استفاده میکنند ردیابی کند و اطلاعاتی درباره مکان اشیاء در میدان دید آنها جمعآوری کند. Quest ۳، دومین دستگاه مورد استفاده برای جمع آوری داده ها، یک هدست واقعیت مجازی (VR) تجاری است که در Meta توسعه یافته است.

بانرجی، اسکودرانی و همکارانشان نوشتند: ژستهای حقیقت زمینی توسط یک سیستم عکاسی حرکتی حرفهای با استفاده از نشانگرهای نوری کوچک متصل به دستها و اشیاء به دست آمدند. حاشیهنویسیهای دستی در فرمتهای UmeTrack و MANO ارائه میشوند و اشیا با مشهای سه بعدی با مواد PBR که توسط یک اسکنر داخلی بهدست میآیند نشان داده میشوند.

برای ارزیابی پتانسیل مجموعه داده HOT۳D برای تحقیق در رباتیک و بینایی کامپیوتر، محققان از آن برای آموزش مدلهای پایه در سه کار مختلف استفاده کردند. آنها دریافتند که این مدلها زمانی که بر روی دادههای چند نمای موجود در HOT۳D آموزش داده میشوند، بهطور قابلتوجهی بهتر از زمانی که بر روی نمایشهایی که یک دیدگاه را به تصویر میکشند، آموزش داده میشوند.

بانرجی، اسکودرانی و همکارانشان نوشتند: «در آزمایشهای خود، کارآمدی دادههای خود محوری چند نما را برای سه کار رایج نشان میدهیم: ردیابی دست سه بعدی، تخمین وضعیت جسمی ۶DoF، و بلند کردن سه بعدی اجسام ناشناخته در دست. روشهای ارزیابیشده چند نما، که محک زدن آنها بهطور منحصربهفردی توسط HOT۳D فعال شده است، بهطور قابلتوجهی از همتایان تکنمای خود بهتر عمل میکنند.

مجموعه داده HOT۳D منبع باز است و میتواند توسط محققان در سراسر جهان در وب سایت پروژه آریا دانلود شود. در آینده میتواند به توسعه و پیشرفت فناوریهای مختلف، از جمله رابطهای انسان و ماشین، رباتها و دیگر سیستمهای مبتنی بر بینایی کامپیوتری کمک کند.